Das Wichtigste vorab:

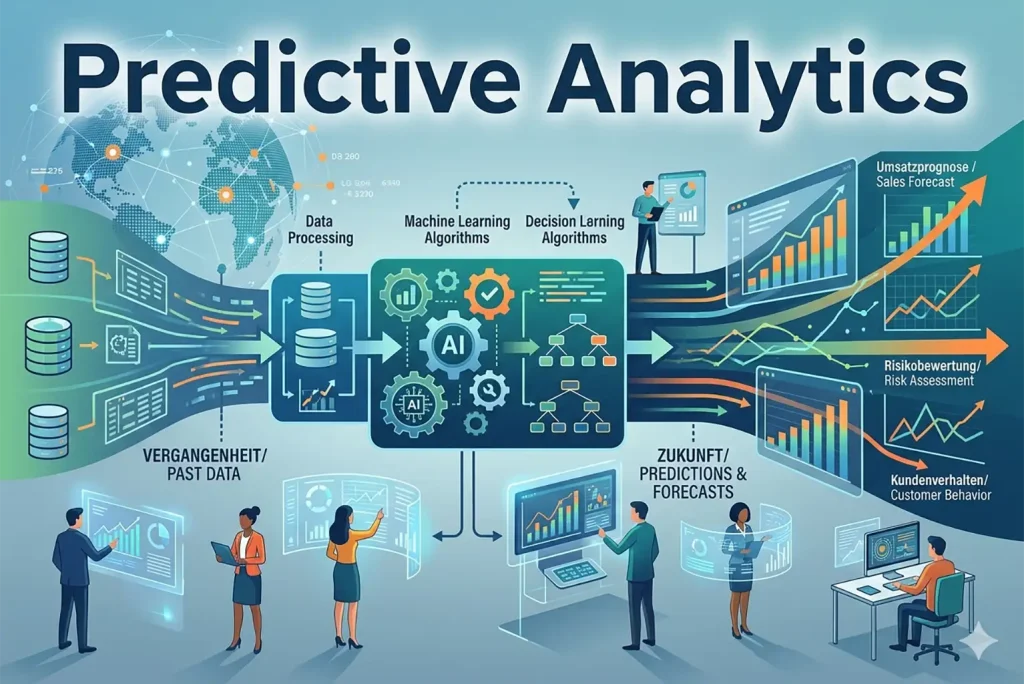

Predictive Analytics nutzt historische Daten, statistische Algorithmen und Machine Learning, um die Wahrscheinlichkeit zukünftiger Ergebnisse vorherzusagen. Es geht nicht darum, die Zukunft exakt zu “wissen”, sondern datenbasierte Prognosen zu erstellen, die Unternehmen dabei helfen, Risiken zu minimieren, die Effizienz zu steigern und personalisierte Kundenerlebnisse zu schaffen. Während klassische Analysen beschreiben, was war, bereitet Predictive Analytics den Boden für proaktive strategische Entscheidungen.

Predictive Analytics – Key Facts auf einen Blick

- Kernziel: Identifikation von Mustern in Altdaten zur Vorhersage künftiger Ereignisse.

- Technologien: Machine Learning (ML), Data Mining, Statistik, Künstliche Intelligenz (KI).

- Wichtigste Methoden: Regressionsanalysen, Entscheidungsbäume, Neuronale Netze.

- Business-Nutzen: Churn-Prävention, Predictive Maintenance, Betrugserkennung, Nachfrageprognose.

- Erfolgsfaktor: Die Qualität der Vorhersage steht und fällt mit der Qualität der zugrunde liegenden Daten (“Garbage in, garbage out”).

1. Definition: Was ist Predictive Analytics?

Um die Einordnung zu verstehen, muss man Predictive Analytics im Kontext der analytischen Reifegrad-Modelle sehen:

- Descriptive: Rückblick auf die Vergangenheit (Reports).

- Diagnostic: Warum ist etwas passiert? (Ursachenanalyse).

- Predictive: Was wird geschehen? (Wahrscheinlichkeitsmodelle).

- Prescriptive: Was sollen wir tun? (Handlungsempfehlungen basierend auf Prognosen).

Durch die Verknüpfung von Mathematik, Informatik und Business Intelligence werden riesige Datenmengen (Big Data) analysiert, um Trends und Verhaltensmuster zu isolieren. Es ist das Werkzeug, das aus einem Rückspiegel (Daten der Vergangenheit) einen Scheinwerfer für die Straße vor uns macht.

„Daten sind das Rohmaterial der Moderne, aber erst die Vorhersage verwandelt sie in wertvolles Wissen.“

2. Wie es funktioniert: Der detaillierte Prozess-Zyklus

Ein erfolgreiches Predictive-Analytics-Projekt ist kein einmaliges Ereignis, sondern folgt meist einem zyklischen Ablauf:

- Zieldefinition: Welches spezifische Geschäftsproblem soll gelöst werden? Statt vager Ziele wie “Umsatz steigern” werden präzise Fragen formuliert, etwa: “Welche Kunden mit einem Jahresumsatz > 5.000 € haben ein Kündigungsrisiko von über 20 %?”

- Datensammlung: Zusammenführung von strukturierten Daten (SQL-Datenbanken, ERP) und unstrukturierten Daten (Social Media, Logfiles, IoT-Sensoren).

- Datenbereinigung (Data Wrangling): Dieser Schritt nimmt oft 80 % der Zeit in Anspruch. Ausreißer werden identifiziert, fehlende Werte durch statistische Verfahren ergänzt und Formate vereinheitlicht.

- Modellierung: Hier wählen Data Scientists den passenden Algorithmus. Das Modell wird mit einem Training-Set gefüttert, um Muster zu erlernen.

- Validierung & Evaluation: Das Modell wird mit einem “unbekannten” Test-Set geprüft. Metriken wie Präzision oder der F1-Score bestimmen die Verlässlichkeit.

- Deployment: Die Integration in die operativen Prozesse, um Vorhersagen in Echtzeit zu liefern.

3. Zentrale Methoden und Algorithmen im Detail

Um präzise Vorhersagen zu treffen, nutzt die Datenwissenschaft verschiedene mathematische Ansätze:

Regressionsanalysen

Die Lineare Regression untersucht den Zusammenhang zwischen einer abhängigen Variablen (Umsatz) und unabhängigen Variablen (Werbebudget). Die Logistische Regression wird für Ja/Nein-Kategorien (z. B. Kreditausfall) genutzt.

Entscheidungsbäume (Decision Trees) & Random Forests

Ein grafisches Modell für Wenn-Dann-Fragen. Ein Random Forest kombiniert hunderte dieser Bäume, um die Genauigkeit massiv zu steigern und Fehler einzelner Bäume auszugleichen.

Neuronale Netze & Deep Learning

Inspiriert durch das menschliche Gehirn, bestehen diese aus Schichten von “Neuronen”. Sie glänzen bei hochkomplexen Aufgaben wie Bilderkennung oder Sprachanalyse.

Zeitreihenanalyse (Time Series)

Fokus auf Datenpunkten in chronologischer Abfolge, um Saisonalität und Trends für zukünftige Werte wie Energiebedarfe zu prognostizieren.

Wünschen Sie hierzu eine Kurzberatung?

4. Umfassende Anwendungsbereiche in der Praxis

Predictive Analytics transformiert die Entscheidungsfindung in verschiedenen Branchen (mobil-optimierte Übersicht):

- E-Commerce: Next Best Offer. Berechnung des Artikels mit dem höchsten Kaufreiz basierend auf dem Klickverhalten.

- Finanzen: Credit Scoring. Sofortige Bewertung von Kreditausfallrisiken und Echtzeit-Betrugserkennung.

- Industrie: Predictive Maintenance. Vermeidung von Stillstandzeiten durch sensorgestützte Wartungsprognosen.

- Marketing: Churn Prediction. Frühzeitige Identifikation abwanderungsgefährdeter Kunden.

- Logistik: Nachfrageprognose. Optimierung der Lagerhaltung durch regionale Bedarfsvorhersagen.

5. Praxisbeispiel: Churn-Prävention durch Predictive Analytics

Um die Theorie greifbar zu machen, betrachten wir das Szenario eines Software-Anbieters (SaaS), der Predictive Analytics nutzt, um die Kundenabwanderung (Churn) zu reduzieren.

Die Ausgangslage:

Das Unternehmen bemerkt, dass 15 % der Kunden ihr Abo nach dem ersten Jahr nicht verlängern. Manuelle Umfragen liefern zu spät Ergebnisse, um die Kunden noch umzustimmen.

Der analytische Ansatz:

Die Data Scientists füttern das Modell mit historischen Daten: Aktivitätsdaten (Login-Frequenz), Support-Historie und Zahlungsverhalten.

Das Ergebnis:

Das Modell identifiziert ein Muster: Kunden, die in den ersten 30 Tagen das Onboarding-Tutorial nicht abgeschlossen haben und deren Login-Frequenz im vierten Monat um mehr als 40 % sinkt, wandern mit einer Wahrscheinlichkeit von 85 % ab.

Die Maßnahme:

Statt auf die Kündigung zu warten, löst das System automatisch eine Kampagne aus. Das Customer-Success-Team kontaktiert diese Kunden proaktiv. Ergebnis: Die Churn-Rate sank innerhalb von sechs Monaten um 20 %.

6. Best Practices für die Implementierung im Unternehmen

Die erfolgreiche Einführung von Predictive Analytics im Unternehmen ist weniger ein rein technisches Projekt als vielmehr eine strategische Transformation. Es bedarf eines klaren Fahrplans, um die Brücke zwischen komplexen Datenmodellen und echtem geschäftlichem Mehrwert zu schlagen. Ohne eine Verankerung in der Unternehmenskultur bleiben selbst die präzisesten Algorithmen wirkungslos.

- Start Small, Scale Fast: Beginnen Sie mit einem “Minimum Viable Product” (MVP), um schnelle Erfolge nachzuweisen. Ein eng umrissener Use-Case erzeugt schneller Akzeptanz als ein mehrjähriges Mammutprojekt.

- Datenqualität vor Quantität: Etablieren Sie klare Prozesse zur Datenpflege (Data Governance). Da Modelle auf Mustern basieren, führen fehlerhafte Daten zu verzerrten Ergebnissen (“Garbage in, garbage out”).

- Interdisziplinäre Teams: Data Scientists müssen eng mit den Fachabteilungen zusammenarbeiten. Ein Algorithmus erkennt Korrelationen, aber nur der Fachexperte beurteilt, ob diese kausal relevant sind.

- Ethik und Datenschutz (GDPR): Transparenz bei automatisierten Entscheidungen ist Pflicht. Nutzer müssen nachvollziehen können, auf welcher Basis ein Scoring zustande kommt.

- Kulturwandel fördern: Management und Mitarbeiter müssen lernen, Entscheidungen auf Basis von Daten statt nur auf Intuition zu treffen. Dies erfordert Schulungen und die Bereitschaft, “Bauchgefühle” kritisch zu hinterfragen.

7. Feature Engineering und Modellauswahl – Das Herzstück der Analyse

Hinter den Kulissen entscheidet vor allem die Vorbereitung der Datenmerkmale, das sogenannte Feature Engineering.

Was ist Feature Engineering?

Es ist der Prozess, bei dem Rohdaten in Merkmale (Features) umgewandelt werden, die das Problem besser repräsentieren. Experten erstellen neue Variablen wie Recency (Tage seit letzter Interaktion), Frequency und Trend-Indikatoren.

Die Auswahl des richtigen Modells

Data Scientists müssen zwischen Interpretierbarkeit und Leistungsfähigkeit abwägen. Ein einfacher Entscheidungsbaum ist leicht zu erklären, ein neuronales Netz bietet oft höhere Genauigkeit, bleibt aber eine “Blackbox”.

„Wer die Muster der Vergangenheit versteht, kann die Weichen für die Zukunft stellen, noch bevor sie eintritt.“

8. Kritische Herausforderungen und Fallstricke

Trotz der enormen Potenziale ist der Weg zu einer funktionierenden prädiktiven Analyse mit Hürden gepflastert, die oft technischer, organisatorischer oder kultureller Natur sind. Das Bewusstsein für diese Stolpersteine ist der erste Schritt, um das Scheitern kostspieliger Projekte zu verhindern.

- Datensilos: Fehlender Datenaustausch zwischen Abteilungen verhindert ein ganzheitliches Bild. Ohne Verknüpfung aller Datenquellen bleibt das Modell unvollständig.

- Überanpassung (Overfitting): Das Modell funktioniert bei historischen Daten perfekt, versagt aber bei neuen Marktsituationen, da es zufällige Schwankungen als feste Regeln missinterpretiert hat.

- Fehlende Erklärbarkeit (Blackbox): Wenn die Logik der KI nicht nachvollziehbar ist, sinkt die Akzeptanz. Besonders in regulierten Branchen müssen Entscheidungen juristisch begründbar bleiben.

- Data Drift: Modelle veralten, wenn sich das reale Verhalten (z. B. durch Krisen) schlagartig ändert. Ein Modell erfordert kontinuierliches Monitoring und Nachtraining.

- Mangelnde Datenstrategie: Ohne eine übergeordnete Strategie, welche Fragen die Daten überhaupt beantworten sollen, verpuffen die Analysebemühungen oft im Leeren.

9. Fazit: Die strategische Bedeutung von Predictive Analytics

Predictive Analytics ist kein Blick in die Kristallkugel, sondern angewandte Mathematik und Informatik auf höchstem Niveau. In einer zunehmend volatilen Welt ist die Fähigkeit, aus der Vergangenheit für die Zukunft zu lernen, der entscheidende Wettbewerbsvorteil. Unternehmen, die Predictive Analytics erfolgreich in ihre DNA integrieren, gewinnen nicht nur an Effizienz, sondern entwickeln eine Agilität, die im Zeitalter der digitalen Transformation über das Überleben am Markt entscheidet. Der Weg dorthin führt über eine saubere Datenstrategie, technologische Neugier und die Bereitschaft, Unternehmenskultur datengetrieben neu zu denken. Der Mensch bleibt dabei als Korrektiv und Stratege unverzichtbar, da er den Zahlen Sinn und Richtung gibt. Letztlich ist Predictive Analytics weit mehr als nur ein technisches Feature; es ist das Fundament für eine zukunftsorientierte, proaktive Unternehmensführung in einer datengesättigten Wirtschaft.

10. FAQ: Predictive Analytics – Experten-Fragen beantwortet

Benötige ich zwingend Big Data für Predictive Analytics?

Nein. Auch mit “Small Data” lassen sich exzellente Ergebnisse erzielen, sofern diese Daten repräsentativ und sauber sind. Qualität schlägt Quantität fast immer.

Was ist der Unterschied zwischen Predictive Analytics und Machine Learning?

Predictive Analytics beschreibt das Geschäftsziel (Vorhersagen treffen). Machine Learning ist die technologische Methode (Algorithmen, die aus Daten lernen), um dieses Ziel effizient zu erreichen.

Wie hoch ist die Treffsicherheit solcher Modelle?

Das hängt vom Case ab. In der Industrie (Wartung) oder im Marketing werden oft Genauigkeiten von weit über 90 % erreicht, während Finanzmärkte volatiler bleiben.

Ist die Implementierung für den Mittelstand bezahlbar?

Ja. Dank Cloud-Computing und “Analytics-as-a-Service” entfallen hohe Investitionskosten für eigene Hardware. Man zahlt nur für die tatsächlich genutzte Rechenleistung.