Das Wichtigste vorab:

Der EU AI Act ist seit 2026 die verbindliche Rechtsgrundlage für Künstliche Intelligenz in Europa. Er unterteilt KI-Anwendungen nach ihrem Risiko und legt strenge Regeln für Transparenz, Sicherheit und menschliche Aufsicht fest. Unternehmen müssen jetzt handeln: Seit April 2026 sind die Governance-Pflichten für Hochrisiko-Systeme voll wirksam. Wer Compliance-Lücken im Einkauf oder Betrieb ignoriert, riskiert Bußgelder von bis zu 35 Mio. € oder 7 % des weltweiten Umsatzes. Das Gesetz markiert das Ende der „Wildwest-Ära“ der KI und transformiert regulatorische Sorgfalt in ein echtes Qualitätssiegel für europäische Unternehmen.

Key Facts zum EU AI Act

- Kernziel: Schutz von Grundrechten und Sicherheit durch „vertrauenswürdige KI“.

- Status 2026: Volle Anwendung der Verbote und Start der Hochrisiko-Regulierung.

- Rollen: Klare Pflichten für Anbieter (Provider) und Betreiber (Deployer) gleichermaßen.

- Einkauf: Zentrale Kontrollinstanz für die Compliance-Prüfung von Drittsoftware.

- Pflicht zur Schulung: Unternehmen müssen die KI-Kompetenz ihrer Mitarbeiter fördern.

1. Definition: Was ist der EU AI Act?

Die Definition von Künstlicher Intelligenz ist hierbei bewusst breit gefasst und orientiert sich an der OECD. Ein System gilt als KI, wenn es mit einem gewissen Grad an Autonomie operiert und aus den erhaltenen Eingaben ableitet, wie es Ergebnisse wie Vorhersagen, Empfehlungen oder Entscheidungen erzeugt.

Da es sich um eine Verordnung (Act/Regulation) handelt, gilt das Gesetz unmittelbar für jedes Unternehmen, das KI-Systeme in der EU in den Verkehr bringt oder deren Ergebnisse hier nutzt – unabhängig davon, ob das Unternehmen seinen Sitz in Berlin, New York oder Shanghai hat. Damit setzt die EU einen globalen Standard, ähnlich wie zuvor mit der DSGVO.

„Innovation ohne Regulierung ist ein Blindflug, aber Regulierung ohne Innovation ist ein Stillstand. Die Kunst liegt darin, Leitplanken zu bauen, die das Tempo nicht drosseln, sondern die Fahrt erst sicher machen.“

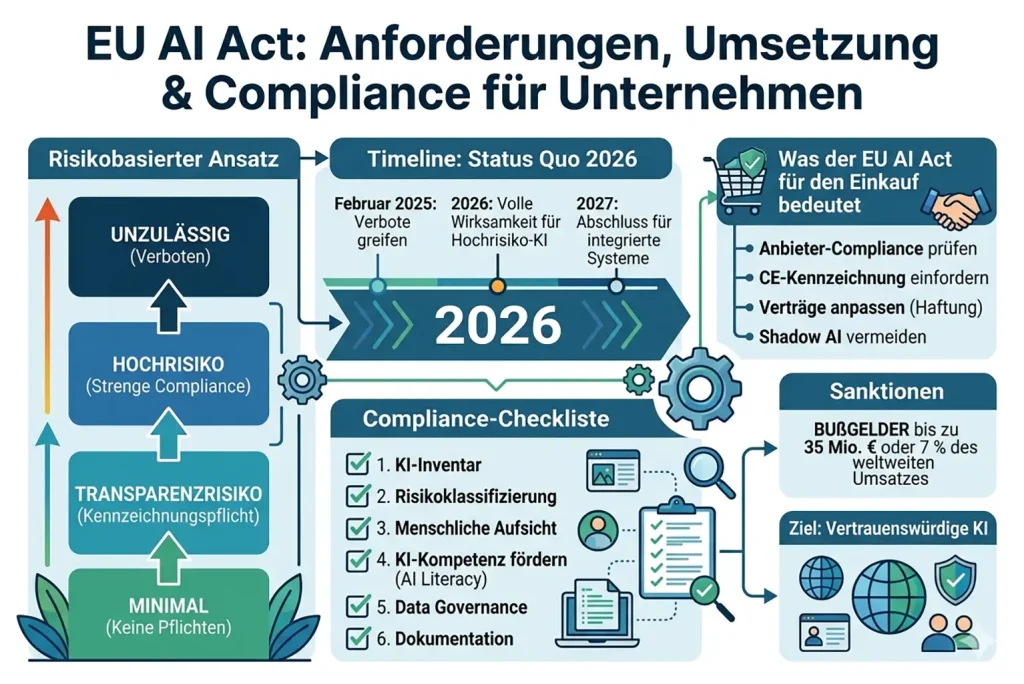

2. Der risikobasierte Ansatz des EU AI Act

Das Herzstück der Regulierung ist die Einstufung von KI-Systemen in verschiedene Risikoklassen. Dieser Ansatz verhindert, dass nützliche, harmlose Anwendungen durch zu viel Bürokratie ausgebremst werden, während gefährliche Anwendungen strikt kontrolliert werden.

- Unannehmbares Risiko (Verboten): In diese Kategorie fallen Anwendungen, die das Potenzial haben, die Menschenwürde massiv zu verletzen. Dazu gehören Social Scoring (die Bewertung sozialen Verhaltens durch den Staat), manipulative Techniken zur Beeinflussung des freien Willens oder die biometrische Fernidentifizierung in Echtzeit im öffentlichen Raum. Diese Systeme sind seit 2025 vollständig untersagt.

- Hochrisiko-KI: Hier wird es für Unternehmen im Jahr 2026 besonders relevant. Systeme, die über Lebenschancen entscheiden (z. B. im Bildungswesen, HR-Tools oder Kreditprüfungen), gelten als Hochrisiko. Sie unterliegen strengen Auflagen hinsichtlich der Datenqualität, der technischen Dokumentation und der Transparenz gegenüber den Behörden.

- Geringes Risiko & Transparenzpflichten: Anwendungen wie Chatbots oder Deepfakes fallen hierunter. Die Hauptanforderung ist die Kennzeichnung: Ein Nutzer muss wissen, dass er gerade mit einer Maschine kommuniziert oder dass ein Bild künstlich erzeugt wurde.

- Minimales Risiko: Dies betrifft die überwältigende Mehrheit der KI-Anwendungen, wie einfache Spam-Filter oder KI in Videospielen. Hier sieht das Gesetz keine zusätzlichen Pflichten vor, außer der Einhaltung allgemeiner Sorgfaltsregeln.

3. Timeline: Der Weg zur vollen Wirksamkeit im Jahr 2026

Die Umsetzung des EU AI Act erfolgt stufenweise, um Unternehmen Zeit für die Anpassung ihrer Prozesse zu geben. Im April 2026 befinden wir uns in einer entscheidenden Phase des Übergangs. Der Prozess begann offiziell im August 2024. Bereits sechs Monate später, im Februar 2025, wurden die Verbote für KI-Systeme mit unannehmbarem Risiko rechtswirksam. Unternehmen, die diese Frist ignoriert haben, stehen bereits heute im Fokus der Aufsichtsbehörden.

Seit August 2025 greifen zudem die Regeln für General Purpose AI (GPAI), also Modelle wie große Sprachmodelle (LLMs), die für vielfältige Aufgaben genutzt werden können. Hier müssen Anbieter bereits Transparenzberichte und technische Unterlagen vorlegen. Der wichtigste Meilenstein für die operative Praxis der meisten Unternehmen ist jedoch der August 2026. Ab diesem Zeitpunkt müssen fast alle Hochrisiko-Systeme die vollen Compliance-Anforderungen erfüllen. Dazu gehört nicht nur die technische Konformität, sondern auch die Implementierung eines funktionierenden Risikomanagementsystems. Wer heute noch nicht mit der Dokumentation begonnen hat, wird die Frist im Sommer kaum halten können.

Wünschen Sie hierzu eine Kurzberatung?

4. Was der EU AI Act für den Einkauf bedeutet

Der Einkauf hat sich im Jahr 2026 zur zentralen Schaltstelle der Compliance entwickelt. Da die wenigsten Unternehmen ihre KI-Modelle von Grund auf selbst entwickeln, werden die meisten KI-Lösungen als „Software as a Service“ (SaaS) eingekauft. Damit wird das Procurement zum „Gatekeeper“.

In der Praxis bedeutet das, dass der Einkauf neue Due-Diligence-Verfahren etablieren muss. Bevor eine neue Software abonniert oder lizenziert wird, muss zwingend geklärt werden, ob KI-Komponenten enthalten sind und in welche Risikoklasse diese fallen. Handelt es sich um eine Hochrisiko-Anwendung, muss der Einkauf die entsprechende CE-Kennzeichnung und die technische Dokumentation vom Anbieter einfordern, noch bevor der Vertrag unterzeichnet wird.

Zudem ändern sich die Vertragsgrundlagen massiv: In Service Level Agreements (SLAs) müssen nun spezifische Klauseln zur Datenqualität, zur Bias-Vermeidung und zur Haftung bei algorithmischen Fehlentscheidungen aufgenommen werden. Ein moderner Einkauf im Jahr 2026 kauft nicht mehr nur Funktionen, sondern rechtssichere Prozesse. Ohne die aktive Mitwirkung des Einkaufs ist eine unternehmensweite Compliance schlicht unmöglich, da jede unbedacht eingekaufte App ein rechtliches Risiko für das gesamte Unternehmen darstellen kann.

5. Deep Dive: GPAI und systemische Risiken

Ein tieferer Blick zeigt die Komplexität der General Purpose AI (GPAI) – also Modelle, die nicht für einen spezifischen Zweck, sondern als Basis für viele Anwendungen dienen (z. B. GPT-4 oder ähnliche LLMs). Die EU unterscheidet hier zwischen Standard-GPAI und Modellen mit systemischem Risiko. Letztere werden anhand ihrer Rechenleistung definiert (Schwellenwert von 10²⁵ FLOPs).

Solche extrem leistungsstarken Modelle könnten bei Fehlfunktionen massive gesellschaftliche Auswirkungen haben, etwa im Bereich der Cybersicherheit oder durch die Verbreitung massiver Desinformation. Anbieter dieser Modelle müssen daher nicht nur Transparenzpflichten erfüllen, sondern auch ihre Cybersicherheit nachweisen und regelmäßig Modellbewertungen durchführen. Für Unternehmen, die diese Modelle via Schnittstelle (API) in ihre eigenen Applikationen integrieren, bedeutet das eine erhöhte Sorgfaltspflicht: Man muss sicherstellen, dass der Basis-Anbieter seine Berichte beim EU AI Office korrekt hinterlegt hat, da man sonst indirekt gegen die eigene Sorgfaltspflicht verstößt.

6. KI-Kompetenz: Die unterschätzte Pflicht für Mitarbeiter

Artikel 4 des EU AI Act führt eine Pflicht ein, die viele Unternehmen bisher unterschätzt haben: Die Förderung der AI Literacy (KI-Kompetenz). Es reicht nicht aus, konforme Software einzukaufen; die Menschen, die sie bedienen, müssen verstehen, wie sie funktioniert und wo ihre Grenzen liegen.

Unternehmen müssen sicherstellen, dass ihre Mitarbeiter in der Lage sind, KI-Ergebnisse kritisch zu hinterfragen. Dies ist besonders wichtig, um Phänomene wie den „Automation Bias“ (das blinde Vertrauen in Maschinenentscheidungen) zu verhindern. Eine geschulte Belegschaft ist die beste Versicherung gegen Fehlbedienungen, die im Rahmen der neuen Regulierung zu Haftungsfällen führen könnten. Die Schulungen müssen dabei stufengerecht sein: Ein Einkäufer benötigt ein anderes Wissen über KI-Risiken als ein Datenspezialist in der IT. KI-Schulungen sind im Jahr 2026 somit kein freiwilliges Benefit mehr, sondern ein integraler Bestandteil der gesetzlichen Compliance.

7. Praxisbeispiel: KI im Recruiting-Prozess

Nehmen wir an, ein Unternehmen führt 2026 ein System ein, das eingehende Bewerberunterlagen automatisch scannt und ein Ranking auf Basis der Erfolgswahrscheinlichkeit erstellt. Gemäß Anhang III des EU AI Act fällt KI im Bereich Beschäftigung und Personalmanagement eindeutig unter die Kategorie Hochrisiko.

In diesem Fall reicht es nicht, das Tool einfach zu nutzen. Das Unternehmen muss als Betreiber (Deployer) nachweisen, dass das System keine diskriminierenden Muster (z. B. gegenüber bestimmten Herkunftsländern oder Geschlechtern) verstärkt. Es muss eine menschliche Aufsicht eingerichtet werden – das heißt, eine reale Person muss das Recht und die technische Möglichkeit haben, das Ranking der KI zu ignorieren oder zu korrigieren. Zudem müssen alle Bewerber darüber informiert werden, dass ihre Daten durch ein solches System verarbeitet werden. Fehlt einer dieser Schritte, droht nicht nur eine Klage wegen Diskriminierung, sondern ein direktes Eingreifen der Aufsichtsbehörden wegen Verstoßes gegen den AI Act.

8. Compliance-Checkliste für Unternehmen: Strategische Umsetzung

Die Einhaltung des EU AI Act ist kein einmaliges Projekt, sondern ein dauerhafter Prozess, der tief in die Unternehmensstruktur eingreift. Um die rechtlichen Anforderungen im Jahr 2026 systematisch zu erfüllen, sollten Unternehmen einer klaren Roadmap folgen. Die folgende Checkliste dient als strategisches Fundament, um von der ersten Bestandsaufnahme bis hin zur laufenden Überwachung alle kritischen Punkte abzudecken und das Haftungsrisiko der Geschäftsführung zu minimieren:

- Lückenlose KI-Inventarisierung: Erfassen Sie jedes einzelne Tool, das im Unternehmen genutzt wird und KI-Definitionen erfüllt – auch versteckte Funktionen in bestehender Software.

- Risiko-Klassifizierung nach Gesetz: Ordnen Sie jedem System eine der vier Risikostufen zu und dokumentieren Sie die Entscheidungsfindung für spätere Audits.

- Rollenbestimmung (Provider vs. Deployer): Klären Sie rechtlich verbindlich, ob Sie nur Anwender sind oder durch Anpassungen am Modell zum Anbieter geworden sind.

- Aufbau eines Risikomanagements: Etablieren Sie für Hochrisiko-KI einen Prozess, der Gefahren für die Sicherheit und Grundrechte fortlaufend identifiziert und minimiert.

- Transparenz-Check der Schnittstellen: Prüfen Sie, ob Informationspflichten gegenüber Kunden, Mitarbeitern und Betroffenen technisch und prozessual umgesetzt sind.

- Implementierung menschlicher Aufsicht: Benennen Sie Personen, die fachlich geschult sind, KI-Entscheidungen zu validieren und das System im Notfall abzuschalten.

- Audit der Daten-Governance: Stellen Sie sicher, dass genutzte Datensätze repräsentativ, fehlerfrei und konform mit dem Urheberrecht sind.

9. Fazit: Warum die EU AI Act Compliance ein Wettbewerbsvorteil ist

Zusammenfassend lässt sich sagen, dass der EU AI Act zwar enorme Anforderungen an die Organisation stellt, aber gleichzeitig eine historische Chance bietet. Im Jahr 2026 ist die Zeit des unregulierten Experimentierens endgültig vorbei. Unternehmen, die ihre Compliance-Hausaufgaben gemacht haben, gewinnen einen entscheidenden Wettbewerbsvorteil: Vertrauen.

„Vertrauen ist im digitalen Zeitalter die härteste Währung. Wer beweist, dass seine Algorithmen fair und sicher sind, wird Kunden binden, während andere an ihrer Intransparenz scheitern.“

Kunden, Partner und Investoren bevorzugen zunehmend Unternehmen, die nachweisen können, dass ihre KI-Lösungen sicher, fair und transparent sind. Die Einhaltung des EU AI Act schützt die Marke vor Reputationsschäden und verhindert existenzbedrohende Bußgelder. Wer die Regulierung nicht als Hürde, sondern als Qualitätsmerkmal begreift, positioniert sich als vertrauenswürdiger Akteur in der globalen digitalen Ökonomie. Letztlich sorgt die EU AI Act Compliance dafür, dass technologische Innovation und menschliche Werte Hand in Hand gehen.

10. FAQ: Häufige Fragen zum EU AI Act

Muss ich jedes KI-Tool registrieren?

Nein. Nur Anbieter von Hochrisiko-Systemen müssen diese in einer EU-Datenbank registrieren. Als Betreiber (Nutzer) müssen Sie jedoch ein internes Verzeichnis führen.

Gilt der EU AI Act auch für Software aus den USA oder China?

Ja, wenn das System in der EU angeboten wird oder die Ergebnisse der KI in der EU Auswirkungen haben (Marktortprinzip).

Was passiert bei Verstößen gegen den EU AI Act?

Es drohen Bußgelder von bis zu 35 Mio. € oder 7 % des weltweiten Jahresumsatzes – je nachdem, welcher Betrag höher ist. Fehler in der Dokumentation werden mit geringeren Summen geahndet.

Gibt es Ausnahmen für kleine Unternehmen (KMU)?

KMUs haben Erleichterungen bei den Dokumentationspflichten und erhalten Unterstützung durch sogenannte „Sandboxes“ zum Testen ihrer Innovationen, müssen aber die Grundregeln der Sicherheit dennoch einhalten.