Le plus important d'abord :

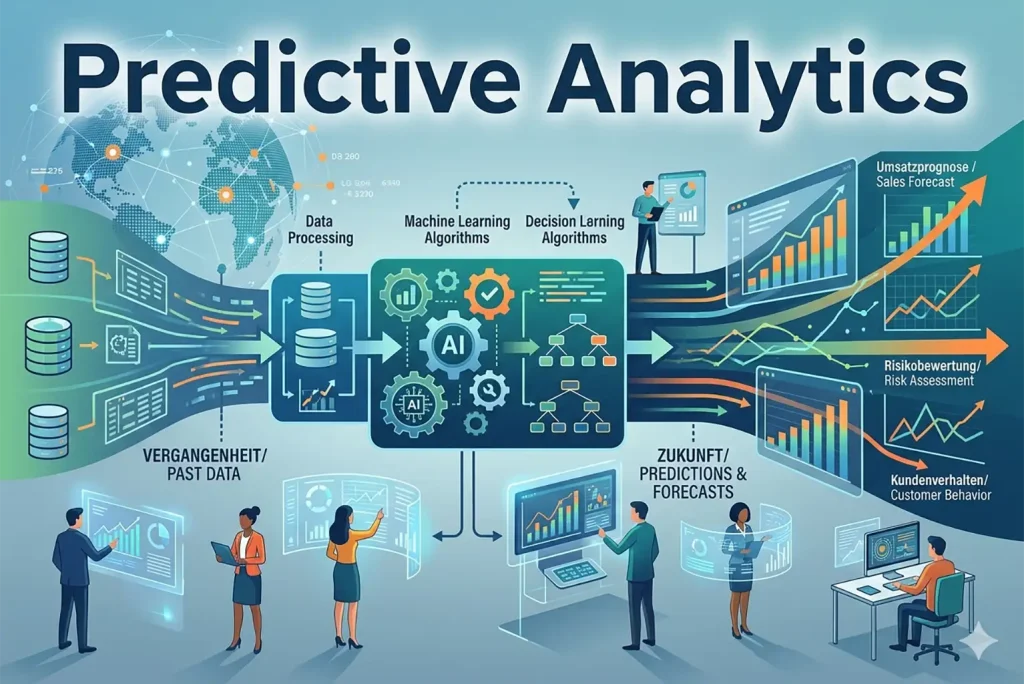

Analyse prédictive utilise des données historiques, des algorithmes statistiques et l'apprentissage automatique pour prédire la probabilité des résultats futurs. Il ne s'agit pas de „ savoir “ l'avenir de manière exacte, mais de créer des prévisions basées sur des données qui aident les entreprises à minimiser les risques, à accroître l'efficacité et à créer des expériences client personnalisées. Alors que l'analyse classique décrit ce qui a été, l'analyse prédictive prépare le terrain pour des décisions stratégiques proactives.

Analytique prédictive – Faits clés en un coup d'œil

- Objectif principal : Identification des modèles dans les données historiques pour prédire les événements futurs.

- Technologies : Apprentissage automatique (ML), Exploration de données, Statistiques, Intelligence artificielle (IA).

- Méthodes principales : analyses de régression, arbres de décision, réseaux neuronaux.

- Avantages commerciaux : Prévention du désabonnement, Maintenance prédictive, Détection de fraude, Prévision de la demande.

- Facteur de succès : La qualité de la prédiction dépend de la qualité des données sous-jacentes („ Garbage in, garbage out “).

1. Définition : Qu'est-ce que l'analyse prédictive ?

Pour comprendre le classement, il faut considérer l'analytique prédictive dans le contexte des modèles de maturité analytique :

- Descriptif : Retour sur le passé (Rapports).

- Diagnostic : Pourquoi quelque chose s'est-il produit ? (Analyse des causes).

- Prédictif : Que va-t-il se passer ? (Modèles de probabilité).

- Prescriptif : Que devrions-nous faire ? (Recommandations d'action basées sur des prévisions).

En associant les mathématiques, l'informatique et la Business Intelligence, d'énormes volumes de données (Big Data) sont analysés afin d'isoler les tendances et les modèles comportementaux. C'est l'outil qui transforme un rétroviseur (données du passé) en phares pour la route devant nous.

„Les données sont la matière première de la modernité, mais seule la prédiction les transforme en connaissances précieuses.“

2. Comment ça marche : Le cycle de processus détaillé

Un projet d'analytique prédictive réussi n'est pas un événement unique, mais suit généralement un processus cyclique :

- Définition de l'objectif : Quel problème commercial spécifique doit être résolu ? Au lieu d'objectifs vagues tels que „ augmenter les ventes “, des questions précises sont formulées, par exemple : „ Quels clients avec un chiffre d'affaires annuel > 5 000 € ont un risque de résiliation supérieur à 20 %? “

- Collecte de données : fusion de données structurées (bases de données SQL, ERP) et de données non structurées (médias sociaux, fichiers journaux, capteurs IoT).

- Nettoyage des données (Data Wrangling) : Cette étape prend souvent 80 % du temps. Les valeurs aberrantes sont identifiées, les valeurs manquantes sont complétées par des méthodes statistiques et les formats sont standardisés.

- Modélisation : Ici, les data scientists choisissent l'algorithme approprié. Le modèle est alimenté par un ensemble d'entraînement pour apprendre des motifs.

- Validation & Évaluation : Le modèle est testé avec un ensemble de test déjà vu. Des métriques comme la précision ou le score F1 déterminent sa fiabilité.

- Déploiement : L'intégration dans les processus opérationnels pour fournir des prédictions en temps réel.

3. Méthodes et algorithmes centraux en détail

Pour faire des prédictions précises, la science des données utilise diverses approches mathématiques :

Analyse de régression

La régression linéaire examine la relation entre une variable dépendante (chiffre d'affaires) et des variables indépendantes (budget publicitaire). La régression logistique est utilisée pour les catégories Oui/Non (par exemple, défaut de crédit).

Arbres de décision et Forêts aléatoires

Un modèle graphique pour les questions "si-alors". Une forêt aléatoire combine des centaines de ces arbres pour augmenter massivement la précision et compenser les erreurs des arbres individuels.

Réseaux neuronaux et apprentissage profond

Inspirés par le cerveau humain, ils sont constitués de couches de „ neurones “. Ils excellent dans des tâches très complexes comme la reconnaissance d'images ou l'analyse du langage.

Analyse de séries chronologiques (Time Series)

Se concentrer sur les points de données dans l'ordre chronologique pour prévoir la saisonnalité et les tendances des valeurs futures, telles que les besoins énergétiques.

Souhaitez-vous un bref conseil à ce sujet ?

4. Domaines d'application complets dans la pratique

L'analyse prédictive transforme la prise de décision dans diverses industries (aperçu optimisé pour mobile) :

- E-commerce : Nouvelle meilleure offre. Calcul de l'article le plus susceptible d'être acheté en fonction du comportement de clic.

- Finances : Scoring de crédit. Évaluation immédiate des risques de crédit et détection de fraude en temps réel.

- Industrie : Maintenance prédictive. Éviter les temps d'arrêt grâce aux prévisions de maintenance basées sur des capteurs.

- Marketing : Prédiction du désabonnement. Identification précoce des clients à risque de désabonnement.

- Logistique : Prévision de la demande. Optimisation des stocks grâce aux prévisions de demande régionales.

5. Exemple pratique : Prévention du churn grâce à l'analyse prédictive

Pour rendre la théorie tangible, considérons le scénario d'un fournisseur de logiciels (SaaS) utilisant l'analyse prédictive pour réduire le désabonnement des clients (Churn).

La situation de départ :

L'entreprise constate que 15 % des clients ne renouvellent pas leur abonnement après la première année. Les enquêtes manuelles fournissent des résultats trop tardifs pour pouvoir persuader les clients de changer d'avis.

L'approche analytique :

Les scientifiques des données alimentent le modèle avec des données historiques : données d'activité (fréquence de connexion), historique du support et comportement de paiement.

Le résultat :

Le modèle identifie un schéma : les clients qui n'ont pas terminé le tutoriel d'intégration dans les 30 premiers jours et dont la fréquence de connexion diminue de plus de 40 % au quatrième mois risquent de se désabonner avec une probabilité de 85 %.

La mesure

Au lieu d'attendre le désabonnement, le système déclenche automatiquement une campagne. L'équipe de Customer Success contacte ces clients de manière proactive. Résultat : le taux de désabonnement a diminué de 20 %en six mois.

6. Meilleures pratiques pour la mise en œuvre en entreprise

La mise en œuvre réussie de l'analyse prédictive en entreprise est moins un projet purement technique qu'une transformation stratégique. Une feuille de route claire est nécessaire pour jeter le pont entre des modèles de données complexes et une réelle valeur commerciale. Sans ancrage dans la culture d'entreprise, même les algorithmes les plus précis resteront inefficaces.

- Commencer petit, accélérer rapidement : commencez par un „ minimum viable product “ (MVP) pour prouver les succès rapides. Un cas d’utilisation clairement défini génère une adoption plus rapide qu’un projet colossal de plusieurs années.

- Qualité des données avant quantité : Établissez des processus clairs pour la gestion des données (gouvernance des données). Les modèles étant basés sur des schémas, des données erronées conduisent à des résultats biaisés („ Garbage in, garbage out “).

- Équipes interdisciplinaires : les scientifiques des données doivent travailler en étroite collaboration avec les départements métiers. Un algorithme détecte les corrélations, mais seul l'expert métier juge si elles sont causalement pertinentes.

- Éthique et protection des données (RGPD) : la transparence dans les décisions automatisées est obligatoire. Les utilisateurs doivent pouvoir comprendre sur quelle base un score est attribué.

- Promouvoir le changement culturel : Le management et les employés doivent apprendre à prendre des décisions basées sur des données plutôt que sur l'intuition. Cela nécessite une formation et la volonté de remettre en question les „ pressentiments “.

7. Ingénierie des caractéristiques et sélection du modèle – Le cœur de l'analyse

En coulisses, c'est surtout la préparation des caractéristiques des données, ce qu'on appelle le feature engineering, qui fait la différence.

Qu'est-ce que l'ingénierie des caractéristiques ?

C'est le processus par lequel les données brutes sont transformées en caractéristiques qui représentent mieux le problème. Les experts créent de nouvelles variables telles que la récence (jours depuis la dernière interaction), la fréquence et les indicateurs de tendance.

Le choix du bon modèle

Les data scientists doivent faire un compromis entre l'interprétabilité et la performance. Un arbre de décision simple est facile à expliquer, tandis qu'un réseau neuronal offre souvent une meilleure précision mais reste une „ boîte noire “.

„Celui qui comprend les modèles du passé peut donner le ton pour l'avenir avant même qu'il n'arrive.“

8. Défis et pièges critiques

Malgré d'énormes potentiels, le chemin vers une analyse prédictive fonctionnelle est semé d'embûches, souvent de nature technique, organisationnelle ou culturelle. La prise de conscience de ces obstacles est la première étape pour éviter l'échec de projets coûteux.

- Silos de données : le manque d'échange de données entre les départements empêche une vision holistique. Sans relier toutes les sources de données, le modèle reste incomplet.

- Surapprentissage (Overfitting) : Le modèle fonctionne parfaitement avec les données historiques, mais échoue dans de nouvelles situations du marché car il a mal interprété des fluctuations aléatoires comme des règles fixes.

- Explicabilité manquante (boîte noire) : Lorsque la logique de l'IA n'est pas compréhensible, l'acceptation diminue. En particulier dans les secteurs réglementés, les décisions doivent rester juridiquement justifiables.

- Dérive des données : Les modèles deviennent obsolètes lorsque le comportement réel (par exemple, en raison de crises) change soudainement. Un modèle nécessite une surveillance et un réentraînement continus.

- Stratégie de données manquante : Sans une stratégie globale définissant les questions auxquelles les données doivent répondre, les efforts d'analyse sont souvent vains.

9. Conclusion : L'importance stratégique de l'analyse prédictive

Analyse prédictive ce n'est pas une boule de cristal, mais de la mathématique appliquée et de l'informatique de haut niveau. Dans un monde de plus en plus volatile, la capacité à tirer des leçons du passé pour l'avenir est l'avantage concurrentiel décisif. Les entreprises qui intègrent avec succès l'analyse prédictive dans leur ADN gagnent non seulement en efficacité, mais développent une agilité qui détermine les chances de survie sur le marché à l'ère de la transformation numérique. Le chemin vers cela passe par une stratégie de données claire, une curiosité technologique et la volonté de repenser la culture d'entreprise de manière axée sur les données. L'homme reste indispensable en tant que correcteur et stratège, car il donne un sens et une direction aux chiffres. En fin de compte, l'analyse prédictive est bien plus qu'une simple fonctionnalité technique ; c'est le fondement d'un leadership d'entreprise tourné vers l'avenir et proactif dans une économie saturée de données.

10. FAQ : Analyse prédictive – Réponses aux questions des experts

Ai-je absolument besoin du Big Data pour l'analyse prédictive ?

Non. Même avec des „ Small Data “ on peut obtenir d'excellents résultats, à condition que ces données soient représentatives et propres. La qualité l'emporte presque toujours sur la quantité.

Quelle est la différence entre l'analyse prédictive et l'apprentissage automatique ?

L'analyse prédictive décrit le but commercial (faire des prédictions). Le machine learning est la méthode technologique (algorithmes qui apprennent à partir de données) pour atteindre cet objectif efficacement.

Quelle est la précision de tels modèles ?

Cela dépend du cas. Dans l'industrie (maintenance) ou le marketing, des précisions bien supérieures à 90 % sont souvent atteintes, tandis que les marchés financiers restent plus volatils.

Est-ce que la mise en œuvre est abordable pour les PME ?

Oui. Grâce au cloud computing et à l„“ Analytics as a Service », les coûts d'investissement élevés pour votre propre matériel sont éliminés. Vous ne payez que pour la puissance de calcul réellement utilisée.