Le plus important d'abord :

le Loi sur l'IA de l'UE devient la base juridique contraignante à partir de 2026 pour Intelligence artificielle en Europe. Il classe les applications d'IA en fonction de leur risque et établit des règles strictes en matière de transparence, de sécurité et de supervision humaine. Les entreprises doivent maintenant agir : depuis avril 2026, les obligations de gouvernance pour les systèmes à haut risque sont pleinement en vigueur. Ceux qui ignorent les lacunes de conformité dans leurs achats ou leurs opérations risquent des amendes allant jusqu'à 35 millions d'euros ou 7 % de leur chiffre d'affaires mondial. La loi marque la fin de „l'ère sauvage“ de l'IA et transforme la diligence réglementaire en un véritable label de qualité pour les entreprises européennes.

Faits essentiels sur la loi européenne sur l'IA

- Objectif principal : Protection des droits fondamentaux et sécurité par une „IA de confiance“.

- Statut 2026: Application complète des interdictions et début de la réglementation à haut risque.

- Rôles : Devoirs clairs pour le fournisseur (Provider) et le déployeur (Deployer) de manière égale.

- Achats : Instance de contrôle centrale pour l'audit de conformité des logiciels tiers.

- Obligation de formation : Les entreprises doivent promouvoir les compétences en IA de leurs employés.

1. Définition : Qu'est-ce que l'AI Act de l'UE ?

La définition de l'intelligence artificielle est volontairement large et s'inspire de l'OCDE. Un système est considéré comme une IA s'il fonctionne avec un certain degré d'autonomie et déduit, à partir des données d'entrée reçues, comment produire des résultats tels que des prédictions, des recommandations ou des décisions.

Puisqu'il s'agit d'un règlement, la loi s'applique directement à toute entreprise qui met sur le marché des systèmes d'IA dans l'UE ou qui utilise leurs résultats ici – que l'entreprise soit basée à Berlin, New York ou Shanghai. Ce faisant, l'UE établit une norme mondiale, à l'instar du RGPD précédemment.

„L'innovation sans réglementation est un vol à l'aveugle, mais la réglementation sans innovation est une stagnation. L'art consiste à construire des glissières de sécurité qui ne ralentissent pas la vitesse, mais la rendent d'abord sûre.“

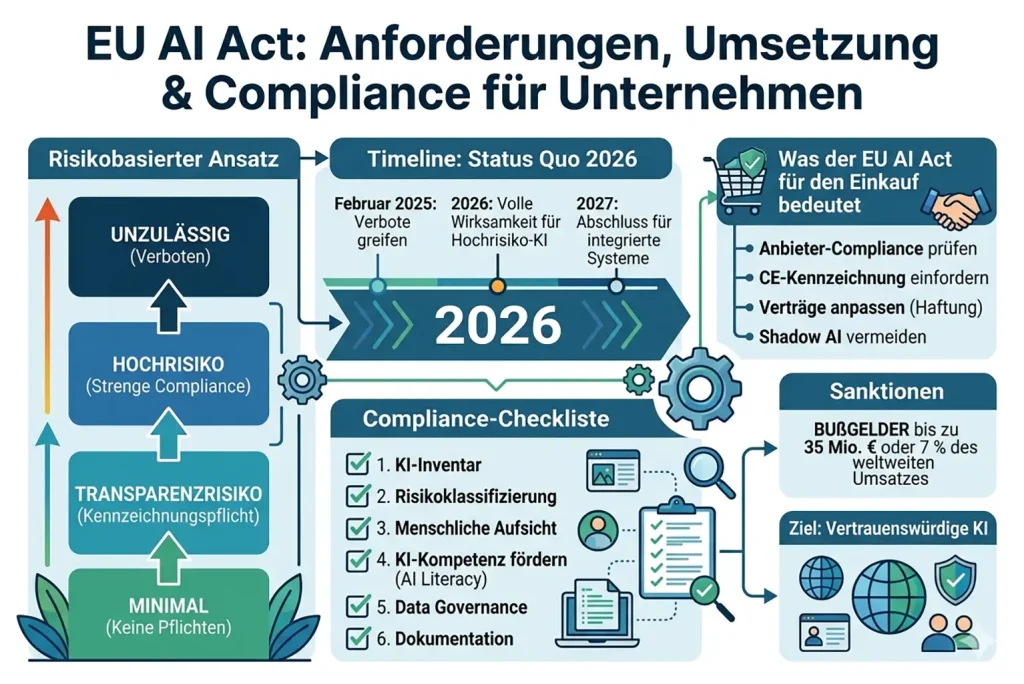

2. L'approche fondée sur les risques du règlement européen sur l'IA

Le cœur de la réglementation réside dans la classification des systèmes d'IA en différentes classes de risque. Cette approche évite que des applications utiles et inoffensives ne soient freinées par trop de bureaucratie, tout en contrôlant strictement les applications dangereuses.

- Risque inacceptable (Interdit) : Cette catégorie couvre les applications susceptibles de porter gravement atteinte à la dignité humaine. Cela inclut le système de notation sociale (l'évaluation du comportement social par l'État), les techniques manipulatrices visant à altérer le libre arbitre, ou encore l'identification biométrique à distance en temps réel dans l'espace public. Ces systèmes sont totalement interdits depuis 2025.

- IA à haut risque : C'est ici qu'elle deviendra particulièrement pertinente pour les entreprises en 2026. Les systèmes qui décident des chances dans la vie (par exemple, dans le domaine de l'éducation, des outils RH ou de l'approbation de crédits) sont considérés comme à haut risque. Ils sont soumis à des exigences strictes en matière de qualité des données, de documentation technique et de transparence envers les autorités.

- Faible risque et obligations de transparence : Les applications telles que les chatbots ou les deepfakes entrent dans cette catégorie. L'exigence principale est l'étiquetage : un utilisateur doit savoir qu'il communique actuellement avec une machine ou qu'une image a été générée artificiellement.

- Risque minimal : Cela concerne la grande majorité des applications d'IA, comme les filtres anti-spam simples ou l'IA dans les jeux vidéo. Pour celles-ci, la loi n'impose aucune obligation supplémentaire, hormis le respect des règles générales de diligence.

3. Calendrier : La voie vers la pleine efficacité en 2026

La mise en œuvre de l'EU AI Act se fera par étapes afin de donner aux entreprises le temps d'adapter leurs processus. En avril 2026, nous nous trouvons dans une phase de transition décisive. Le processus a officiellement débuté en août 2024. Six mois plus tard, en février 2025, les interdictions des systèmes d'IA présentant un risque inacceptable sont déjà entrées en vigueur. Les entreprises qui ont ignoré ce délai sont déjà dans le collimateur des autorités de surveillance.

À partir d'août 2025, les règles relatives à l'IA à usage général (GPAI), c'est-à-dire les modèles tels que les grands modèles linguistiques (LLM) qui peuvent être utilisés pour diverses tâches, entreront également en vigueur. Ici, les fournisseurs devront déjà fournir des rapports de transparence et de la documentation technique. Cependant, l'étape la plus importante pour la pratique opérationnelle de la plupart des entreprises sera août 2026. À partir de cette date, presque tous les systèmes à haut risque devront satisfaire aux exigences de conformité complètes. Cela inclut non seulement la conformité technique, mais aussi la mise en œuvre d'un système de gestion des risques fonctionnel. Ceux qui n'ont pas encore commencé la documentation aujourd'hui auront du mal à respecter le délai d'ici l'été.

Souhaitez-vous un bref conseil à ce sujet ?

4. Ce que l'AI Act de l'UE signifie pour les achats

le Achats s'est développée pour devenir le centre névralgique de la conformité en 2026. Comme très peu d'entreprises développent leurs modèles d'IA à partir de zéro, la plupart Solutions IA acquis en tant que „ Software as a Service “ (SaaS). Le processus d'approvisionnement devient ainsi le „ gardien “.

En pratique, cela signifie que le service des achats doit mettre en place de nouvelles procédures de diligence raisonnable. Avant de souscrire ou de licencier un nouveau logiciel, il est impératif de déterminer s'il contient des composants d'IA et dans quelle classe de risque ceux-ci entrent. S'il s'agit d'une application à haut risque, le service des achats doit exiger le marquage CE correspondant et la documentation technique du fournisseur avant même la signature du contrat.

De plus, les conditions contractuelles changent massivement : les accords de niveau de service (SLA) doivent désormais inclure des clauses spécifiques sur la qualité des données, la prévention des biais et la responsabilité en cas de décisions algorithmiques erronées. Un service achats moderne en 2026 n'achète plus seulement des fonctionnalités, mais des processus juridiquement sûrs. Sans la participation active du service achats, la conformité à l'échelle de l'entreprise est tout simplement impossible, car chaque application achetée sans précaution peut représenter un risque juridique pour l'ensemble de l'entreprise.

5. Plongée en profondeur : IA Générative et risques systémiques

Un examen plus approfondi révèle la complexité de l'IA à usage général (GPAI) – c'est-à-dire des modèles qui ne sont pas destinés à un usage spécifique, mais servent de base à de nombreuses applications (par exemple, GPT-4 ou des LLM similaires). L'UE distingue ici la GPAI standard des modèles présentant un risque systémique. Ces derniers sont définis par leur puissance de calcul (seuil de$10^{25} $ FLOPs).

Des modèles aussi performants pourraient avoir des répercussions sociétales massives en cas de dysfonctionnement, par exemple dans le domaine de la cybersécurité ou par la diffusion de désinformation massive. Les fournisseurs de ces modèles devront donc non seulement satisfaire aux obligations de transparence, mais aussi prouver leur cybersécurité et procéder à des évaluations régulières des modèles. Pour les entreprises qui intègrent ces modèles dans leurs propres applications via une interface (API), cela implique une diligence accrue : il faut s'assurer que le fournisseur sous-jacent a correctement déposé ses rapports auprès du Bureau de l'IA de l'UE, faute de quoi l'on manquerait indirectement à sa propre obligation de diligence.

6. Compétences en IA : Le devoir sous-estimé pour les employés

L'article 4 du règlement européen sur l'IA introduit une obligation que de nombreuses entreprises ont jusqu'à présent sous-estimée : la promotion de l'alphabétisation à l'IA (ou IA-compétences). Il ne suffit pas d'acheter des logiciels conformes ; les personnes qui les utilisent doivent comprendre leur fonctionnement et leurs limites.

Les entreprises doivent s'assurer que leurs employés sont capables de remettre en question de manière critique les résultats de l'IA. Ceci est particulièrement important pour prévenir des phénomènes tels que le „ biais d'automatisation “ (la confiance aveugle dans les décisions des machines). Une main-d'œuvre formée est la meilleure assurance contre les mauvaises utilisations qui pourraient entraîner des cas de responsabilité dans le cadre de la nouvelle réglementation. Les formations doivent être adaptées au niveau requis : un acheteur a besoin de connaissances différentes sur les risques liés à l'IA qu'un spécialiste des données en informatique. Ainsi, en 2026, les formations sur l'IA ne seront plus un avantage facultatif, mais un élément intégral de la conformité légale.

7. Exemple pratique : l'IA dans le processus de recrutement

Supposons qu'une entreprise introduise en 2026 un système qui analyse automatiquement les candidatures reçues et génère un classement basé sur la probabilité de succès. Conformément à l'annexe III du règlement européen sur l'IA, l'IA dans le domaine de l'emploi et de la gestion des ressources humaines relève clairement de la catégorie à haut risque.

Dans ce cas, il ne suffit pas d'utiliser l'outil. L'entreprise, en tant que déployeur, doit prouver que le système ne renforce pas de schémas discriminatoires (par exemple, envers certains pays d'origine ou genres). Une supervision humaine doit être mise en place – c'est-à-dire qu'une personne réelle doit avoir le droit et la possibilité technique d'ignorer ou de corriger le classement de l'IA. De plus, tous les candidats doivent être informés que leurs données sont traitées par un tel système. Si l'une de ces étapes manque, non seulement il y a un risque de poursuites judiciaires pour discrimination, mais aussi une intervention directe des autorités de contrôle pour violation de l'AI Act.

8. Checklist de conformité pour les entreprises : mise en œuvre stratégique

La conformité à l'EU AI Act n'est pas un projet ponctuel, mais un processus permanent qui s'inscrit profondément dans la structure de l'entreprise. Pour se conformer systématiquement aux exigences légales en 2026, les entreprises devraient suivre une feuille de route claire. La liste de contrôle suivante sert de base stratégique pour couvrir tous les points critiques, de l'inventaire initial à la surveillance continue, et pour minimiser le risque de responsabilité de la direction :

- Inventaire complet de l'IA : capturez chaque outil utilisé dans l'entreprise qui répond aux définitions de l'IA, y compris les fonctionnalités cachées dans les logiciels existants.

- Classification des risques selon la loi : attribuez à chaque système l'un des quatre niveaux de risque et documentez la prise de décision pour les audits ultérieurs.

- Détermination du rôle (fournisseur vs. déployeur) : Clarifiez de manière juridiquement contraignante si vous n'êtes qu'un utilisateur ou si vous êtes devenu un fournisseur par le biais d'adaptations du modèle.

- Établir un processus pour l'IA à haut risque qui identifie et minimise en continu les dangers pour la sécurité et les droits fondamentaux.

- Vérification de la transparence des interfaces : Vérifiez si les obligations d'information envers les clients, les employés et les personnes concernées sont mises en œuvre techniquement et procéduralement.

- Mise en œuvre de la surveillance humaine : Nommez les personnes dûment formées pour valider les décisions de l'IA et arrêter le système en cas d'urgence.

- Audit de la gouvernance des données : Assurez-vous que les ensembles de données utilisés sont représentatifs, sans erreurs et conformes au droit d'auteur.

9. Conclusion : Pourquoi la conformité au règlement européen sur l'IA est un avantage concurrentiel

En résumé, le Loi sur l'IA de l'UE bien qu'énormes exigences à l'organisation, offre en même temps une opportunité historique. En 2026, le temps des expérimentations non réglementées sera définitivement révolu. Les entreprises qui ont fait leurs devoirs en matière de conformité gagneront un avantage concurrentiel décisif : la confiance.

„La confiance est la monnaie la plus précieuse à l'ère numérique. Ceux qui prouvent que leurs algorithmes sont justes et sécurisés fidéliseront leurs clients, tandis que d'autres échoueront en raison de leur manque de transparence.“

Les clients, partenaires et investisseurs privilégient de plus en plus les entreprises qui peuvent démontrer que leurs solutions d'IA sont sûres, équitables et transparentes. Le respect du règlement européen sur l'IA protège la marque contre les atteintes à la réputation et évite des amendes potentiellement lourdes. Ceux qui perçoivent la réglementation non pas comme un obstacle, mais comme un gage de qualité, se positionnent comme des acteurs de confiance dans l'économie numérique mondiale. En fin de compte, la conformité au règlement européen sur l'IA garantit que l'innovation technologique et les valeurs humaines progressent main dans la main.

10. FAQ : Questions fréquemment posées sur la loi sur l'IA de l'UE

Dois-je enregistrer chaque outil d'IA ?

Non. Seuls les fournisseurs de systèmes à haut risque doivent les enregistrer dans une base de données de l'UE. En tant qu'opérateur (utilisateur), vous devez cependant tenir un registre interne.

La loi européenne sur l'IA s'applique-t-elle également aux logiciels provenant des États-Unis ou de Chine ?

Oui, si le système est proposé dans l'UE ou si les résultats de l'IA ont un impact dans l'UE (principe du marché).

Que se passe-t-il en cas de non-respect du règlement européen sur l'IA ?

Des amendes pouvant aller jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires annuel mondial – le montant le plus élevé étant retenu – sont encourues. Les erreurs de documentation seront sanctionnées par des sommes moins importantes.

Existe-t-il des exceptions pour les petites et moyennes entreprises (PME) ?

Les PME bénéficient d'allégements en matière d'obligations de documentation et reçoivent un soutien de la part de "sandboxes" pour tester leurs innovations, mais elles doivent néanmoins respecter les règles de base en matière de sécurité.